Развитие искусственного интеллекта (ИИ) невозможно без соответствующей инфраструктуры.

Мощные алгоритмы требуют надёжных вычислительных ресурсов, эффективных систем хранения данных и продуманной архитектуры. Разберёмся, из чего состоит современная инфраструктура для ИИ и какие решения предлагают ведущие игроки рынка.

Что такое инфраструктура для ИИ?

Инфраструктура для ИИ — это комплекс аппаратных и программных решений, обеспечивающих разработку, обучение, развёртывание и эксплуатацию ИИ‑систем. Она включает:

- вычислительные мощности;

- системы хранения данных;

- сетевые компоненты;

- инструменты разработки и управления;

- средства обеспечения безопасности.

Ключевые компоненты инфраструктуры

- Вычислительные ресурсы

Основалюбой ИИ‑инфраструктуры — мощные процессоры, способные обрабатывать огромные массивы данных:

- CPU (центральные процессоры) — подходят для общих вычислений и управления процессами.

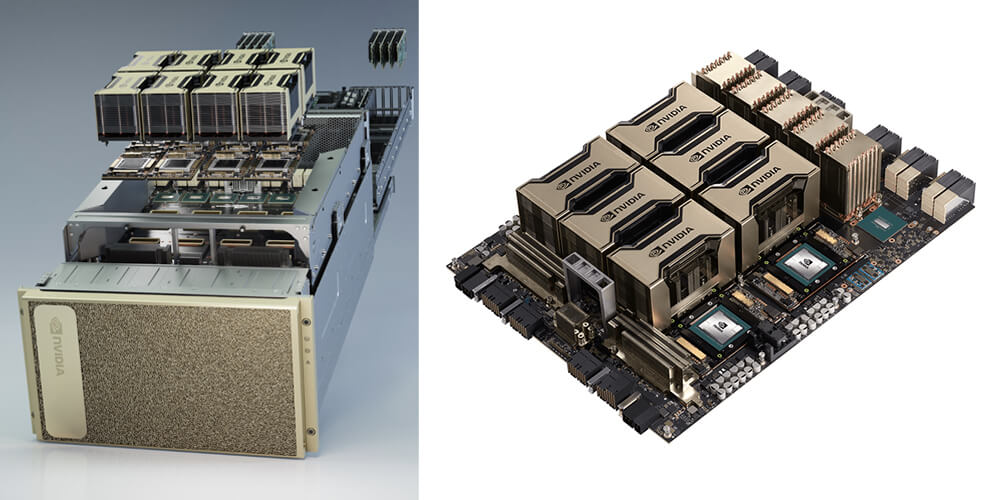

- GPU (графические процессоры) — оптимальны для параллельных вычислений, ускоряют обучение нейросетей в десятки раз. Лидеры: NVIDIA (серии A100, H100), AMD Instinct.

- TPU (тензорные процессоры от Google) — специализированные чипы для задач машинного обучения.

- ASIC и FPGA — специализированные интегральные схемы для конкретных задач ИИ.

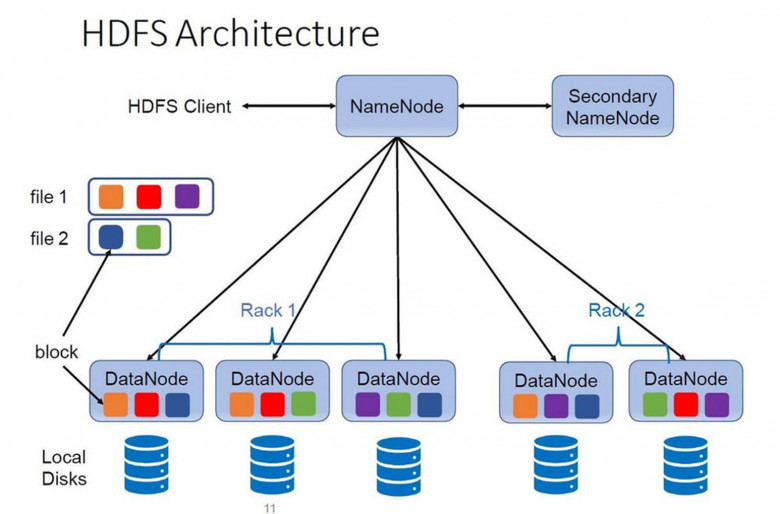

- Системы хранения данных

ИИ‑системы работают с терабайтами и петабайтами данных. Требования к хранилищам:

- высокая пропускная способность для быстрого доступа к данным;

- масштабируемость (возможность наращивать объём);

- надёжность и отказоустойчивость.

Варианты:

- распределённые файловые системы (HDFS);

- объектные хранилища (S3‑совместимые);

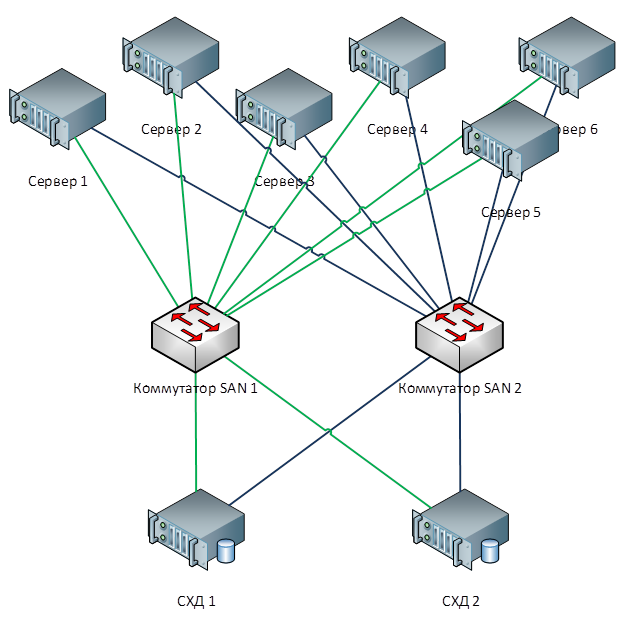

- высокопроизводительные SAN/NAS;

- in‑memory хранилища для критически важных задач.

- Сетевая инфраструктура

Быстрая передача данных между компонентами — критически важный элемент:

- высокоскоростные сети (10GbE, 40GbE, InfiniBand);

- низкая задержка (latency) для распределённого обучения;

- балансировка нагрузки между узлами.

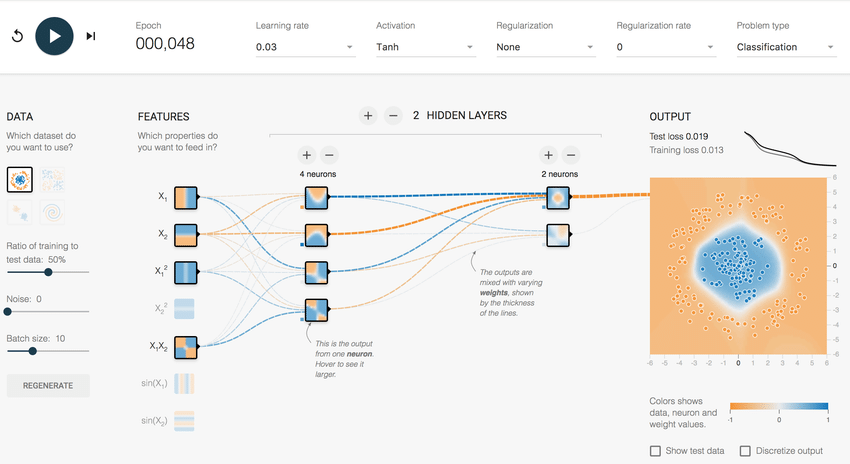

- Инструменты разработки и оркестрации

Программные платформы, упрощающие работу с ИИ:

- фреймворки: TensorFlow, PyTorch, Keras;

- платформы для MLOps: Kubeflow, MLflow, Weights& Biases;

- оркестраторы контейнеров: Kubernetes, DockerSwarm.

- Средства мониторинга и управления

Для стабильной работы нужны инструменты контроля:

- мониторинг нагрузки на GPU/CPU;

- отслеживание использования памяти;

- логирование экспериментов;

- управление жизненным циклом моделей.

- Безопасность

Защита данных и моделей:

- шифрование данных при передаче и хранении;

- контроль доступа к ресурсам;

- защита от adversarial‑атак на модели ИИ.

Типы инфраструктурны хрешений

- Локальные (on‑premise) решения

Собственные серверные мощности компании.

Плюсы:

- полный контроль над данными и инфраструктурой;

- независимость от интернет‑соединения;

- возможность тонкой настройки подзадачи.

Минусы:

- высокие капитальные затраты;

- необходимость обслуживания и обновлений;

- ограниченная масштабируемость.

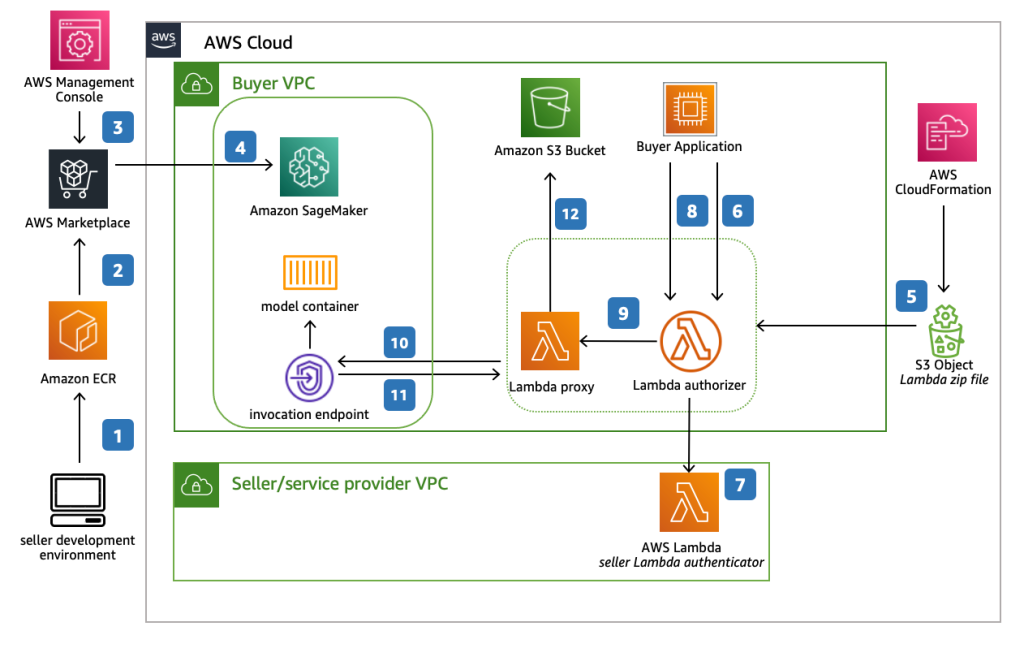

- Облачные решения

Аренда ресурсов у провайдеров:

- AWS (AmazonSageMaker, EC2P4/G5 инстансы);

- Google Cloud (AIPlatform, TPUv4);

- Microsoft Azure(AzureMachineLearning);

- IBMCloud (WatsonStudio).

Плюсы:

- быстрое развёртывание;

- оплата по модели «pay‑as‑you‑go»;

- автоматическое масштабирование;

- доступ к новейшим технологиям.

Минусы:

- зависимость от провайдера;

- возможные проблемы с конфиденциальностью;

- затраты прид лительном использовании.

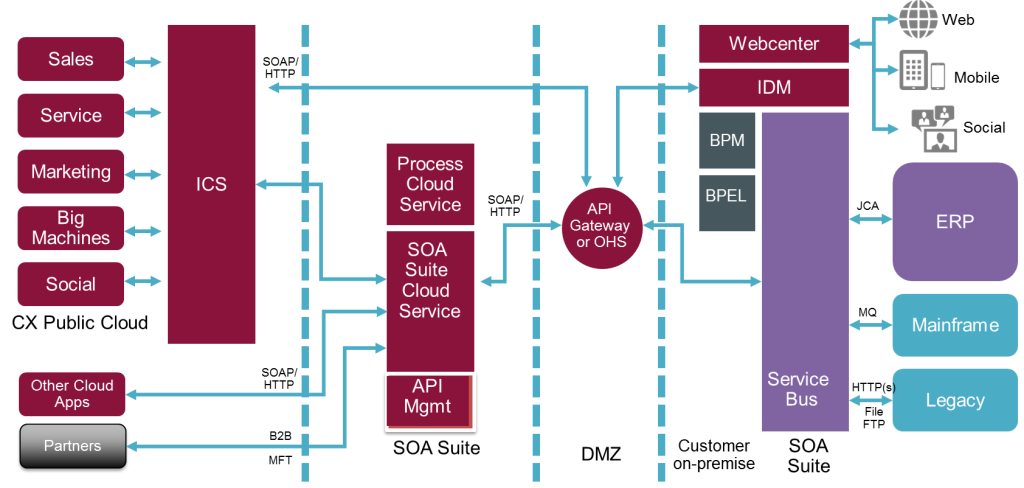

- Гибридные решения

Комбинация локальных и облачных ресурсов:

- чувствительные данные хранятся on‑premise;

- обучение моделей выполняется в облаке;

- inference (выводы) может быть распределён.

Плюсы:

- баланс между контролем и масштабируемостью;

- оптимизация затрат;

- гибкость в распределении нагрузки.

- Edge‑решения

Развёртывание ИИ на периферийных устройствах:

- IoT‑датчики с ИИ‑алгоритмами;

- промышленные контроллеры с машинным обучением;

- мобильные устройства с локальным inference.

Плюсы:

- минимальная задержка;

- работа без постоянного интернет‑соединения;

- снижение нагрузки на центральные системы.

Минусы:

- ограниченные вычислительные возможности устройств;

- сложность управления распределённой инфраструктурой.

Примеры реализаций

- Крупные технологические компании (Google, Meta, Microsoft) строят собственные суперкомпьютеры для обучения больших языковых моделей. Например кластер NVIDIA DGX с тысячами GPU.

- Финансовые организации используют гибридные решения: данные хранятся локально, а обучение моделей выполняется в защищённых облаках.

- Промышленные предприятия внедряют edge‑ИИ для предиктивного обслуживания оборудования: датчики анализируют вибрации и температуру прямо на производстве.

- Стартапы часто начинают с облачных платформ (AWSSageMaker), чтобы минимизировать начальные инвестиции.

Тренды развития инфраструктуры для ИИ

- Ускорители следующего поколения

- появление чипов с энергоэффективностью;

- развитие квантовых вычислений для ИИ.

- Специализированные архитектуры

- процессоры, оптимизированные под конкретные типы нейросетей;

- интеграция памяти и вычислений (in‑memory computing).

- Автоматизация инфраструктуры

- инструменты AutoML для автоматического подбора архитектуры моделей;

- интеллектуальное управление ресурсами.

- Экосистема MLOps

- стандартизация процессов развёртывания и мониторинга моделей;

- платформы полного цикла отданных до inference.

- Энергоэффективность

- снижение углеродного следа ИИ‑систем;

- использование возобновляемых источников энергии для дата‑центров.

- Федеративное обучение

- обучение моделей на распределённых данных без их централизации;

- повышение конфиденциальности за счёт локального обучения.

Заключение

Современная инфраструктура для ИИ — это сложная экосистема, сочетающая аппаратные мощности, программные инструменты и сетевые решения. Выбор оптимального варианта зависит от:

- масштаба задач (стартап, корпорация, госсектор);

- требований к конфиденциальности данных;

- бюджета и сроков внедрения;

- компетенций команды.

В ближайшие годы ключевыми направлениями станут:

- дальнейшее развитие специализированных чипов;

- рост популярности гибридных и edge‑решений;

- автоматизация управления инфраструктурой через MLOps;

- повышение энергоэффективности ИИ‑систем.

Компании, инвестирующие в гибкую и масштабируемую инфраструктуру, получат преимущество в разработке и внедрении передовых ИИ‑решений.

Добавить комментарий